Telegram的敏感内容过滤机制:平衡自由与责任

在即时通讯与社交平台领域,Telegram以其强大的加密功能、频道(Channels)和群组(Groups)的大容量支持而著称,吸引了全球数亿用户。然而,与任何开放的公共平台一样,如何管理用户生成内容,特别是过滤敏感或有害信息,成为Telegram面临的核心挑战之一。Telegram采取了一套独特且常常引发讨论的内容管理策略,试图在用户隐私、言论自由与平台安全之间寻找平衡。

默认设置与用户自主控制

Telegram的一个核心理念是将控制权交给用户。与许多平台主动扫描和过滤所有内容的做法不同,Telegram默认情况下不会主动监控私人聊天和秘密聊天(端到端加密)的内容。对于公开的频道、群组和机器人,平台则提供了工具让用户自主管理。用户可以在“设置” -> “隐私和安全” -> “敏感内容”中,找到控制选项。例如,用户可以启用“限制敏感内容”功能,系统将自动过滤其认为可能包含成人或暴力材料的公开频道和机器人内容,使其在搜索和预览中不可见。这种设计将选择权交给了用户个体,而非平台一刀切。

对公开内容的监管与举报机制

对于公开传播内容的领域,如大型频道和群组,Telegram并非完全放任。平台制定了明确的服务条款和社区指南,禁止诸如恐怖主义宣传、极端暴力、儿童虐待材料、非法毒品交易以及大规模的垃圾信息等行为。Telegram依靠用户举报作为主要的内容监管手段。当一条消息或一个频道被足够多的用户举报后,平台的内容审核团队会进行人工审查。如果确认违规,平台将采取限制访问、删除内容甚至封禁相关账号或频道的措施。这种“事后响应”模式,减少了主动监控,但也对举报系统的效率和审核团队的能力提出了高要求。

本地化法律遵从与信息屏蔽

为了在特定国家或地区合法运营,Telegram在某些情况下会遵从当地法律要求。当收到来自特定司法管辖区的有效法院命令或政府要求时,Telegram可能会屏蔽在该区域内访问某些被认定为非法的公开频道或内容。这一做法通常具有地域针对性,意味着该内容可能在其他地区仍然可见。这种做法体现了Telegram在坚持其原则的同时,为维持服务可访问性而做出的务实妥协,但也时常引发关于审查和标准一致性的争议。

技术手段与挑战

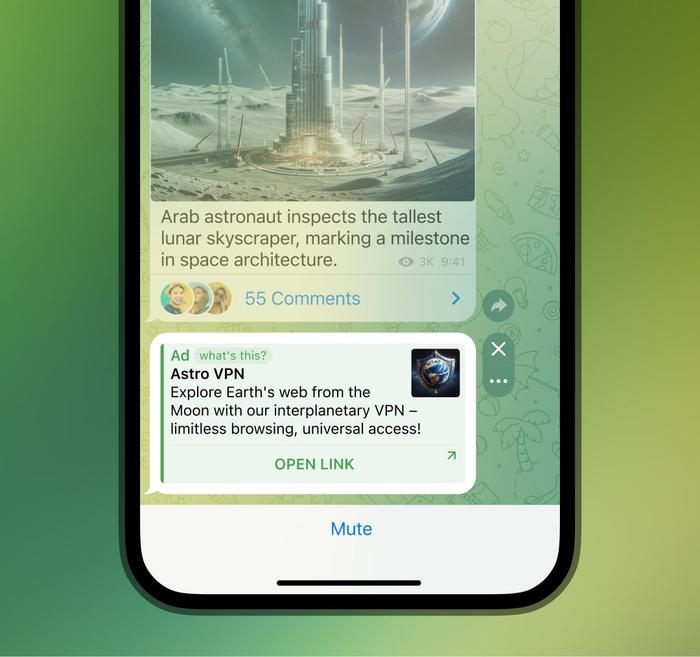

在技术层面,Telegram也运用了一些自动化工具。例如,其拥有一个专门的“垃圾信息及滥用内容过滤器”,用于自动检测和限制传播恶意软件、钓鱼链接或大规模垃圾信息的账户。然而,与一些大型社交网络相比,Telegram在利用人工智能大规模主动识别图像、视频或文本敏感内容方面显得较为保守,这主要出于对用户隐私和加密承诺的考量。这种技术选择使得平台在应对海量有害内容传播时,可能面临反应速度的挑战。

持续的争议与平衡之道

Telegram的内容管理策略始终伴随着争议。支持者赞扬其保护隐私和自由,批评者则指责其成为虚假信息、仇恨言论和非法活动的温床。平台一直在艰难地走钢丝:一方面要维护其作为自由和安全通讯工具的声誉,另一方面又要应对来自各国政府、国际社会和用户群体日益增长的内容监管压力。

总之,Telegram的敏感内容过滤机制并非一个全面主动的筛查系统,而是一个结合了用户自主选择、社区举报驱动、有限技术干预以及本地化法律遵从的混合模型。它反映了创始人杜洛夫所倡导的“自由至上”理念,同时也揭示了在去中心化与全球运营的现实中,一个平台在内容治理上所面临的复杂性与必然的妥协。对于用户而言,了解这些机制并善用个人隐私设置,是在享受Telegram强大功能的同时,保护自身免受不良信息侵扰的关键。